Od pytania otwartego do insightu. AI w analizie jakościowej.

Kiedy respondent wpisuje w ankiecie „w sumie ok” albo „nie wiem, kupiłem bo była promocja” — co z tym zrobić? Przez lata odpowiedź była prosta: badacz czyta, kategoryzuje, powtarza tysiąc razy. Żmudne, czasochłonne i podatne na niespójności między osobami kodującymi.

W In-Pulse zbudowaliśmy dwa autorskie systemy oparte na generatywnej AI, które zmieniają ten proces od podstaw. Nie po to, żeby wyeliminować badacza — ale żeby dać mu czas na to, co robi najlepiej: interpretację, wnioskowanie i rekomendacje.

Poniżej opisuję, jak to działa, co osiągnęliśmy i dlaczego model hybrydowy — człowiek i AI razem — daje lepsze wyniki niż każde z nich osobno.

Punkt wyjścia: problem, którego nie można bagatelizować

Zacznijmy od liczby, która powinna zatrzymać każdego, kto pracuje z danymi z badań: według raportu Insights Association z marca 2025, nawet 69% respondentów w badaniach online to nie są prawdziwi ludzie. Boty, farmy klikaczy, odpowiedzi generowane automatycznie — to nie jest marginalny problem, to strukturalne wyzwanie dla jakości danych.

Do tego dochodzi zjawisko, które w środowisku badawczym określa się jako odpowiedzi low-effort: krótkie, „bez treści”, losowe lub czysto formalne wypowiedzi, które formalnie przechodzą walidację ankiety, ale nie niosą żadnej wartości analitycznej. W tradycyjnym procesie ich wykrycie i odfiltrowanie spoczywało wyłącznie na barkach badacza — po fakcie, ręcznie, przy każdym projekcie od nowa.

Przed wdrożeniem AI kodowanie odpowiedzi otwartych w prostym projekcie badawczym zajmowało zespołowi nawet dwa dni pracy. Przy rosnącej skali badań i coraz większych wolumenach danych — to stawało się wąskim gardłem całego procesu.

Dwa narzędzia, jeden cel: wyższa jakość insightów

Zbudowaliśmy dwa komplementarne systemy:

PulseCheck — ocena jakości zebranych odpowiedzi. System analizuje każdą odpowiedź pod kątem jej merytorycznej wartości: czy odnosi się do pytania, czy zawiera konkret, czy nie nosi znamion odpowiedzi generowanej automatycznie. Wykrywa wzorce charakterystyczne dla zawodowych respondentów i flaguje odpowiedzi wymagające uwagi badacza.

OpenPulse — semantyczna klasyfikacja pytań otwartych. System nie szuka słów kluczowych — rozumie znaczenie wypowiedzi i przypisuje je do kategorii tematycznych, emocjonalnych i intencyjnych. Co ważne: kategorie nie są z góry narzucone. Model sam proponuje strukturę kodów na podstawie rzeczywistych danych, a następnie ewoluuje wraz z kolejnymi falami badań.

Oba systemy działają w modelu human-in-the-loop: AI wykonuje pierwszą klasyfikację, badacz waliduje próbkę, a system uczy się na tej walidacji. Im więcej badań, tym lepsza precyzja — bez konieczności przebudowania narzędzia.

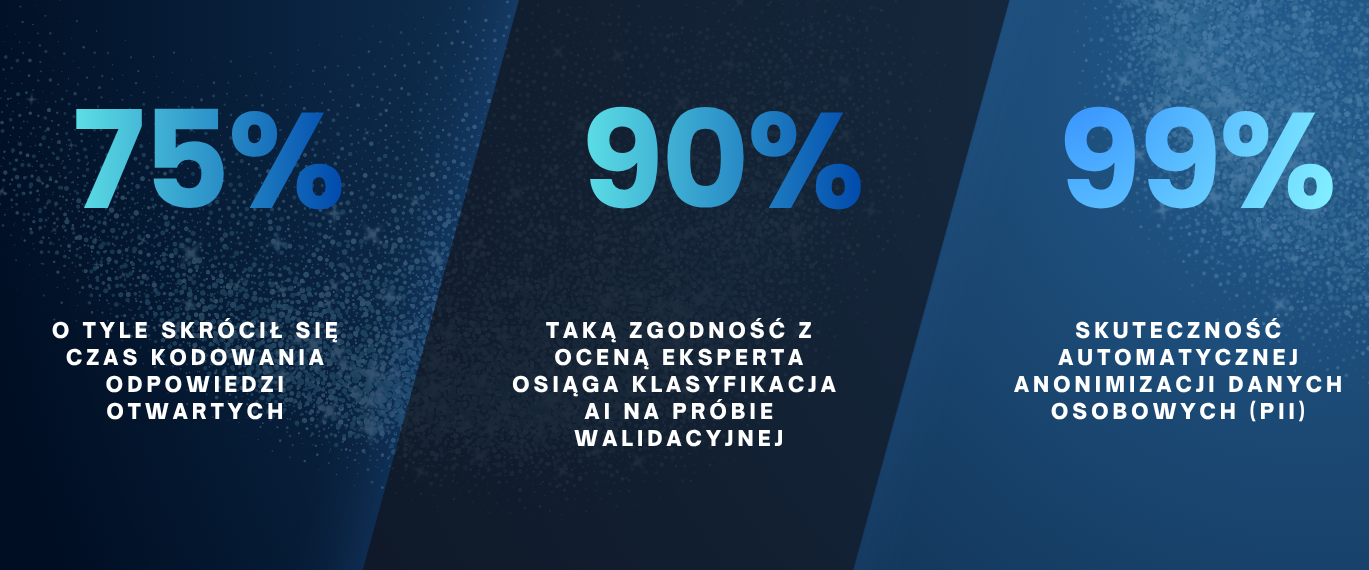

75% — o tyle skrócił się czas kodowania odpowiedzi otwartych przy zachowaniu jakości akceptowanej przez badaczy

90% — taką zgodność z oceną eksperta osiąga klasyfikacja AI na próbie walidacyjnej

5h — maksymalny czas od zamknięcia ankiety do pierwszych wyników (wcześniej: do 2 dni przy prostych projektach)

99% — skuteczność automatycznej anonimizacji danych osobowych (PII) w odpowiedziach otwartych

Co konkretnie robi system — i czego nie robi

Zanim ktoś wyobrazi sobie czarną skrzynkę, która „po prostu działa” — warto być precyzyjnym co do tego, na czym polega innowacyjność i gdzie są granice.

Tradycyjna analiza tekstu opiera się na słowach kluczowych i regułach: jeśli pojawia się słowo „drogi”, odpowiedź trafia do kategorii „cena”. To podejście jest szybkie, ale ślepe na kontekst. „Nie jest drogi jak na tę jakość” i „jest zdecydowanie za drogi” to zupełnie różne insighty — klasyczna analiza słownikowa nie odróżni ich od siebie.

OpenPulse pracuje na poziomie semantycznym — rozumie znaczenie zdania w kontekście całej wypowiedzi i pytania, na które odpowiadała. Efektem jest wielopoziomowa klasyfikacja: tematyczna (o czym mówi respondent), emocjonalna (z jakim zabarwieniem) i intencyjna (jaka stoi za tym postawa lub zamiar).

PulseCheck idzie krok dalej i ocenia nie tylko co powiedziano, ale czy w ogóle warto to analizować. System na przykład porównuje odpowiedź otwartą z odpowiedziami zamkniętymi w tej samej ankiecie — i wykrywa sprzeczności, które mogą sygnalizować nieuważne wypełnianie lub odpowiedzi generowane automatycznie.

Dane osobowe i RODO: problem który łatwo przeoczyć

Jedno z niedocenianych ryzyk w automatycznej analizie odpowiedzi otwartych dotyczy danych osobowych. Respondenci — często nieświadomie — wpisują w polach tekstowych swoje imię, adres, numer telefonu itp.

Przed przekazaniem jakiejkolwiek odpowiedzi do systemu AI wdrożyliśmy proces automatycznego wykrywania i maskowania danych PII (Personally Identifiable Information). Skuteczność tego mechanizmu mierzymy rygorystycznie: cel to minimum 99% poprawnych maskowań w próbkach testowych, zero incydentów krytycznych.

To nie jest kwestia techniczna na marginesie projektu — to warunek konieczny jego zgodności z RODO i zaufania klientów, którzy powierzają nam dane swoich respondentów.

Co to znaczy dla klientów In-Pulse

Jakość narzędzia analitycznego bezpośrednio przekłada się na jakość insightów, które klient otrzymuje:

Szybszy dostęp do wyników.

Skrócenie czasu od zamknięcia ankiety do pierwszych wniosków z dni do godzin oznacza, że decyzje biznesowe mogą być podejmowane w oparciu o świeże dane — nie dane sprzed tygodnia.

Wyższa jakość materiału źródłowego.

Automatyczna identyfikacja odpowiedzi low-effort i odpowiedzi niespójnych oznacza, że analiza opiera się na tym, co respondenci naprawdę powiedzieli — nie na szumie danych.

Głębsze insighty z pytań otwartych.

Semantyczna klasyfikacja wielopoziomowa wydobywa z odpowiedzi otwartych więcej niż zliczanie słów kluczowych. Widać nie tylko co respondenci mówią, ale jak i dlaczego.

Porównywalność między badaniami.

Spójna taksonomia kategorii — stosowana automatycznie we wszystkich projektach — umożliwia śledzenie zmian w opiniach i postawach w czasie, między segmentami i między falami badań.

Dlaczego hybrydowy model działa lepiej niż pełna automatyzacja

Przy projektowaniu systemu stanęliśmy przed dylematem, który dotyczy każdego wdrożenia AI w procesach eksperckich: ile autonomii dać algorytmowi?

Pełna automatyzacja byłaby szybsza i tańsza. Ale oznaczałaby też rezygnację z kontroli nad sensem i znaczeniem — a to właśnie jest rdzeń pracy badawczej. Klasyfikacja „technicznie poprawna” to nie to samo co klasyfikacja „merytorycznie trafna”.

Model human-in-the-loop, który wdrożyliśmy, opiera się na prostej zasadzie: AI wykonuje, człowiek waliduje i uczy. Badacz nie przegląda wszystkich odpowiedzi — przegląda próbkę, ocenia jakość klasyfikacji i koryguje tam gdzie AI się myli. Te korekty wracają do modelu jako dane treningowe.

Efektem jest system, który z każdym projektem staje się precyzyjniejszy — i badacz, który zamiast kodować tysiące odpowiedzi, skupia się na tym, co w jego pracy naprawdę tworzy wartość.

Pytania i odpowiedzi:

Odpowiedzi low-effort to wypowiedzi, które formalnie spełniają wymagania ankiety (np. minimalna liczba znaków), ale nie niosą żadnej wartości merytorycznej — np. losowe ciągi liter, powtórzenia, odpowiedzi całkowicie niezwiązane z pytaniem. Ich udział w danych zaniża jakość insightów i może prowadzić do błędnych wniosków. Według raportu Insights Association (marzec 2025), nawet 69% respondentów w badaniach online może nie być prawdziwymi ludźmi.

Human-in-the-loop to podejście, w którym AI wykonuje pierwsze przejście przez dane (klasyfikację, ocenę jakości), a człowiek — w tym przypadku doświadczony badacz — waliduje próbkę wyników i koryguje błędy. Te korekty wracają do modelu jako dane treningowe. Dzięki temu system jest coraz precyzyjniejszy, a badacz zachowuje kontrolę nad sensem i znaczeniem klasyfikacji.

LinkedIn

LinkedIn